Eentje uit de oude doos, maar zes jaar na de oorspronkelijke publicatie nog steeds relevant. Zelfs de gekke Trump-verwijzing is prachtig ouder geworden.

Phishing was als dreiging nog niet ernstig genoeg, A.I. moet ons het leven toch nog net iets moeilijker maken. Enkele weken lanceerde Google zijn nieuwste AI-videogenerator VEO 3 en het internet ontplofte weer een beetje. Een heel klein beetje, want je zou denken dat we er stilaan aan gewend geraken.

Hyperrealistische video’s maken is nu makkelijker dan ooit. Meteen verschenen filmpjes op TikTok, Instagram, LinkedIn,… over de mogelijkheden, maar ook over de gevaren. Over de risico’s voor wie het zelfs zonder overtuigende, valse video’s al moeilijk heeft om feit te onderscheiden van fictie.

In de archieven van het oude Tech & Leven vond ik onlangs de onderstaande tekst terug. Die dateert uit 2019, zes jaar geleden ondertussen, en gaat over mijn toenmalige inschatting van het gevaar van deepfakes. Wat mij betreft was het geen loze voorspelling. En een leuke tekst. Daarom breng ik hem hier graag terug, inclusief gekke Trump-verwijzing die me toen vooral grappig leek – maar vandaag even realistisch oogt als de video’s van VEO 3.

De oorspronkelijke tekst

Deepfakes bereiken een nieuw niveau van gevaarlijkheid nu hackers menselijke stemmen nabootsen om geld over te maken. Waar eindigt dit?

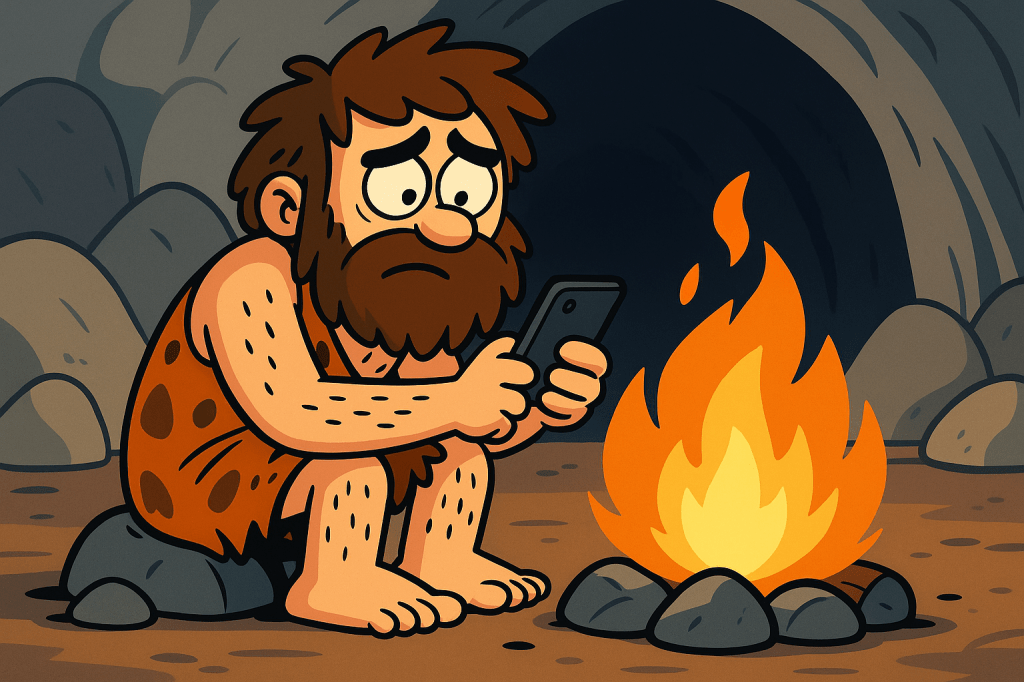

Het is het jaar 2025 en we leven opnieuw in grotten. Mijn vrouw/medeholbewoonster komt binnen met de visvangst van de dag. Ikzelf ben een man aan het kampvuur; ik doe de was-in-de-beek en de plas. Strijken doe ik met een platte steen en ik lust niet graag vis. Ik weet dat het moeilijke jaren zijn en dat iedereen water bij de wijn nog meer water moet doen, maar vandaag slaat de wanhoop weer toe.

Hoe het zover kwam? In 2017 kwamen voor het eerst deepfakes in omloop: slimme IT-mensen vonden een manier om met behulp van machine learning gezichten van bekende actrices op de lichamen van porno-actrices te plaatsen. Het leek net alsof die actrice ook écht bezig was met porno. Het bleek bovendien niet eens zo moeilijk om de deepfakes overtuigend te maken.

De jaren erop evolueerde de technologie steeds verder, ook al waarschuwden vele slimme mensen voor het gevaar en riepen ze op om voorzichtig te zijn met de ontwikkeling van de toepassingen die zo’n dingen mogelijk maakten.

Helaas, zonder veel impact. In het vermaledijde jaar 2019 doken namelijk plots de eerste deepfake-telefoontjes op. En het was al zo slecht gesteld met onze veiligheid: het was immers al langer mogelijk om biometrische beveiliging te omzeilen. Irisscanners bleken minder goed in het scannen van irissen dan gedacht – ze konden om de tuin worden geleid met afbeeldingen. Vingerafdruksensoren werden gefopt met 3D-prints die werden gemaakt op basis van een foto van een duim op televisie. (N.v.d.r. anno 2025: De afdruk was afkomstig van toenmalig Duits defensieminister ‘U. von der Leyen’.)

Maar we hadden onze stem nog. Niemand die ons dat kon afpakken. Tot ze dat plots wel konden. Iets unieker dan een stem is er nochtans niet: iemand die jou kent, herkent je meteen als je hen aanspreekt. Stemmen vervormen konden we natuurlijk. Niet als onszelf klinken was makkelijk.

Toen begonnen de telefoontjes. Slimmerds wisten computergestuurde modellen te ontwikkelen die klonken als je baas. Als je baas je een opdracht geeft om een bepaalde leverancier te betalen, dan doe je dat, toch? Waarom zou je zelfs twijfelen aan de authenticiteit van het telefoontje? Je ként je baas, je kent zijn stem en je wéét hoe die spreekt. Dat sommige klanken onduidelijk zijn omdat er net een trein passeert, dat hoort bij de soundtrack van het leven. Geen reden om argwanend te zijn, toch?

Daarna brak de hel los. Eerst stukje bij beetje, daarna als een vloedgolf waarop de vier ruiters des doods op een Pegasus komen aanstormen. Met de Walkuren in hun zog – afhankelijk van welke mythologie je het leukst vindt, kan je zelf je doemscenario kiezen. Een druppel die verandert in een stroom en ontwikkelt tot een tsunami.

Zo gaan die dingen: iemand vindt iets leuk uit en plots explodeert het succes. Zoals Niantic dat de vraag naar Pokémon Go niet aankon en hulp nodig had van Google om servers bij te plaatsen. Zo gebeurde het ook met de deepfakes: eerst enkelen, algauw duizenden. En het wordt steeds makkelijker (slik).

Na de porno volgden dus de geldoverschrijvingen. Al snel gingen bedrijven overkop. Opnieuw eerst de kleintjes, daarna zelfs groteren. Orders die gevoelig waren werden steeds minder per mail of telefoon doorgegeven. Mensen gingen weer over op vocale overdracht. De maatschappij kende regressie: technologie werd gewantrouwd en op sommige plekken zelfs geweerd. Mensen hadden opnieuw sociaal contact en even leken de deepfakes een zegen die slechts was vermomd als een zwarte plaag.

Tot de deepfakes opdoken op het nieuws. President Trump had de oorlog verklaard aan Noord-Korea, dat op zijn beurt enkele kernkoppen afschoot ter voorbarige zelfverdediging. Wereldoorlog 3 brak uit en niet veel later zat ik hier, in mijn grot, als man aan de kampvuurhaard.

Plaats een reactie